用文字来简单描述视频内容是影视评介经要常做的事情,Facebook 试图将这一工作交给人工智能来做。为此,他们的研究人员创建了一个名为 VideoStory 的视频描述数据集,以训练根据社交媒体的视频自动用文字讲故事的系统。

研究人员在比利时布鲁塞尔自然语言处理经验方法会议(EMNLP)之前发表的一篇新论文——《讲述社交媒体视频故事的数据集》——对此进行了描述。

研究团队在社交媒体上寻找“高参与度”的视频,创建了由 20000 个视频和 123000 个描述性句子构成的数据集。由于社交媒体视频涵盖了广泛的主题和类别,将每个视频中的信息整合到描述事件序列的详细说明中是一个很大的挑战。对于每一个长度从 20 秒到 180 秒不等的视频,团队提供了描述对象、情况和重要细节的带注释的段落,并用相应的时间戳排列句子。最后,视频片段平均有 5 个句子,每个句子平均约 18 秒。

接下来,研究人员将训练一个人工智能系统。该系统将使用 VideoStory 自动为视频创建文字描述。总共有 17098 个视频被用于培训,999 个和 1011 个视频分别被保留用于验证和测试。

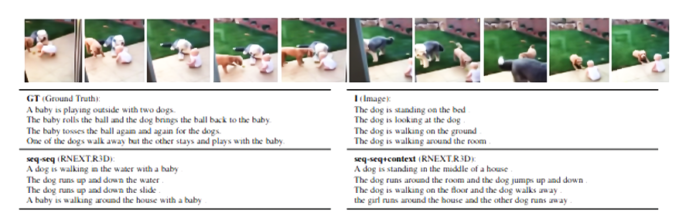

研究小组使用循环神经网络——一种用于自然语言处理任务的神经网络——来描述给定视频的每个片段。同时将来自以前每个片段描述的语境与第二个机器学习模型相结合,以确保整个系统充分考虑过去和未来事件之间的相关性。

“高质量的视频描述不仅仅是一个个单句字幕,它们应该讲述一个连贯的故事。”研究人员写道,“评估显示,由于更多样化的主题和选择引人入胜的视频来讲述故事,我们的数据集与之前的作品相辅相成。我们的 VideoStory 数据集可以作为一个很好的基准来构建故事理解和多句子视频描述的模型。“

Facebook 的研究虽然针对的是社交媒体的视频传播(让不能或不方便观看视频的人消费视频内容),但显然有更广泛的用途。

【数字叙事 Lighting】