认知科学博士内森·惠特莫尔(Nathan Whitmore)使用 OpenAI 的文本生成器 GPT-2 玩文字冒险游戏,发现这一 AI 模型有一定的创作能力,但随机性很强。

GPT-2 被称为革命性的人工智能写作模型,能够撰写以假乱真的新闻故事和仿写名家小说,在今年 2 月公布后引发了很大的争议。由于担心被滥用,OpenAI 在 2 月和 5 月仅针对部分研究人员发布了较小的版本。此后又发布了包含 7.74 亿个参数的版本,但仍不是完整版本,完整的模型包含大约 15 亿个参数。

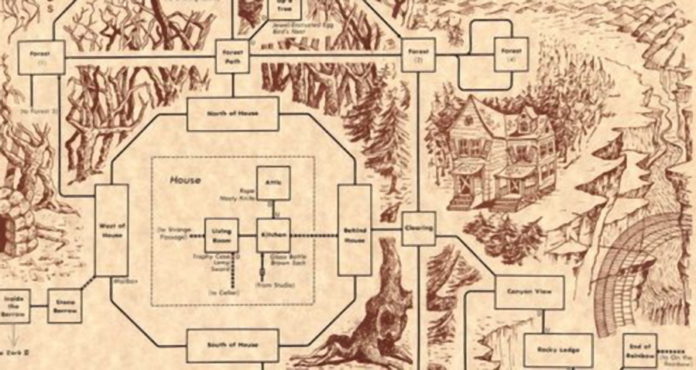

惠特莫尔用文字冒险游戏《Zork》和《Colossal Cave》的文字记录来训练 GPT-2,这些文字创建于 1970 年代中期。经过训练后,GPT-2 能生成与旧版文字冒险游戏相似的文字段落:AI 用几句话描述了一个环境和事件;玩家继续输入文本,AI 接着生成了理论上适合文本输入的游戏的下一部分。

惠特莫尔的项目名为“GPT 冒险”。从测试的情况看,GPT-2 生成的文本缺乏连贯的故事情节,位置描述有时是矛盾的,并且经常会产生奇怪的描述,比如“吃掉支柱”、“舔小偷”。不过这些不合常情的描述倒具有幽默的附加值。

【数字叙事 Lighting】

[…] OpenAI 原是一家非盈利机构,自去年微软的资本加入后,该机构开始在经营方面活跃起来。他们最著名的产品GPT-2被称为革命性的人工智能写作模型,能够撰写以假乱真的故事和仿写名家小说。GPT-2 目前已被应用于文本写作、文字游戏和智能语音等领域。该机构将促进人工智能造福人类作为自己的终极目标。 […]